Top 5 Kasus Penggunaan Web Scraping untuk Otomasi, Pembelajaran Mesin, dan Wawasan Bisnis

Ethan Collins

Pattern Recognition Specialist

Di tengah revolusi digital, data telah menjadi aset paling berharga bagi perusahaan. Web Scraping, teknologi kunci untuk memperoleh jumlah besar informasi jaringan publik secara efisien, semakin menjadi fondasi untuk mendorong otomatisasi bisnis, memperkuat model pembelajaran mesin, dan memperdalam wawasan komersial. Ini bukan hanya alat teknis tetapi juga kemampuan strategis kritis bagi bisnis untuk memperoleh keunggulan kompetitif dan memungkinkan pengambilan keputusan real-time.

Artikel ini akan membahas lima aplikasi inti web scraping di tiga domain strategis "Otomatisasi", "Machine Learning", dan "Insight Bisnis". Kami akan memberikan wawasan unik dan saran implementasi praktis untuk membantu perusahaan melampaui pesaing dan membangun bisnis berbasis data bernilai tinggi.

I. Web Scraping: Langkah Lompatan dari Teknologi ke Strategi

Metode penelitian pasar tradisional dan pengumpulan data sering kali memakan waktu, mahal, dan tidak memiliki kemampuan real-time. Web scraping, dengan menggunakan program otomatis (crawler) untuk mensimulasikan perilaku penjelajahan manusia dan mengekstrak data yang terstruktur dari halaman web, secara signifikan meningkatkan efisiensi dan skala pengumpulan data.

Tiga Nilai Strategis Web Scraping:

- Otomatisasi: Menugaskan tugas pengumpulan data yang berulang dan memakan waktu kepada mesin, melepaskan sumber daya manusia untuk fokus pada analisis dan pengambilan keputusan.

- Machine Learning: Menyediakan dataset pelatihan skala besar, berkualitas tinggi, dan kustomisasi untuk model AI kompleks—nyawa dari kinerja model.

- Insight Bisnis: Menyediakan gambaran pasar real-time dan komprehensif, mendukung strategi harga dinamis, analisis kompetitor, dan prediksi tren.

II. Analisis Mendalam Lima Aplikasi Inti

Kami akan fokus pada lima skenario aplikasi yang paling berdampak, yang bukan hanya praktik industri umum tetapi juga kunci untuk mencapai kompetisi yang berbeda.

1. Memperkuat Model Machine Learning: "Pipeline Data" untuk Data Pelatihan Berkualitas Tinggi

Di era kecerdasan buatan, kebenaran bahwa "data menentukan batas atas dari sebuah model" diterima secara luas. Web scraping adalah metode paling efektif untuk membangun dataset pelatihan berkualitas tinggi dan kustomisasi.

| Tantangan | Solusi Web Scraping | Wawasan dan Nilai Unik |

|---|---|---|

| Dataset publik sudah usang atau tidak relevan | Penjelajahan data spesifik domain secara real-time memastikan kebaruan dan relevansi data. | Pembuatan Label Kustomisasi: Dengan menjelajah ulasan, tag, atau informasi klasifikasi situs web tertentu, label yang lebih halus dapat secara otomatis dihasilkan untuk data, jauh melebihi tingkat granularitas dataset umum. |

| Volume data yang tidak cukup | Penjelajahan skala besar teks, gambar, metadata video, dll., untuk membangun dataset jutaan dalam waktu singkat. | Fusi Data Multimodal: Menjelajah tidak hanya teks, tetapi juga deskripsi gambar terkait dan data interaksi pengguna, untuk melatih model AI lintas modal yang lebih kompleks. |

| Bias data | Menjelajah data dari sumber yang berbeda untuk validasi silang dan keseimbangan, mengurangi bias data dari sumber tunggal. | Pemantauan Data Drift: Terus menjelajah data dan membandingkannya dengan data pelatihan model untuk mendeteksi perubahan distribusi data (data drift) secara tepat waktu, memandu retraining model. |

【Saran Praktis】: Saat menjelajah data untuk model ML, proses pembersihan dan struktur data harus dianggap sebagai komponen inti dari pipeline penjelajahan, memastikan keseragaman format data dan akurasi label.

2. Pemantauan Harga Kompetitor Real-Time dan Strategi Harga Dinamis

Di sektor e-commerce dan ritel, harga adalah faktor paling langsung yang memengaruhi keputusan pembelian konsumen. Web scraping memungkinkan pemantauan dalam milidetik harga kompetitor, stok, dan aktivitas promosi, sehingga mendukung strategi Harga Dinamis.

Dengan terus menjelajah harga SKU (Stock Keeping Unit), informasi diskon, dan status stok dari kompetitor utama, perusahaan dapat memasukkan data ini ke dalam algoritma harga mereka. Model pembelajaran mesin kemudian dapat menyesuaikan harga produk secara real-time berdasarkan elastisitas permintaan, pergerakan kompetitor, dan data penjualan historis untuk memaksimalkan keuntungan atau pangsa pasar.

【Nilai Berbeda】: Di luar harga saja, menjelajah "Riwayat Perubahan Harga" dan "Strategi Penjualan Paket" memberikan wawasan yang lebih dalam. Misalnya, menganalisis besarnya penyesuaian harga kompetitor selama liburan tertentu dapat memprediksi perilaku pemasaran mereka di masa depan.

3. Analisis Sentimen Pasar dan Manajemen Reputasi Merek

Media sosial, forum, situs berita, dan bagian ulasan e-commerce mengandung sejumlah besar data sentimen konsumen. Dengan menjelajah data teks tidak terstruktur ini dan menggabungkannya dengan teknologi Pemrosesan Bahasa Alami (NLP), perusahaan dapat melakukan analisis sentimen skala besar.

- Insight Bisnis: Memahami umpan balik pasar secara instan setelah peluncuran produk baru, mengidentifikasi secara cepat kelemahan produk atau titik kesulitan layanan.

- Otomatisasi: Mengidentifikasi komentar negatif dan sinyal krisis secara otomatis, memicu sistem peringatan dini untuk manajemen reputasi merek yang otomatis.

【Wawasan Unik】: Tingkat granularitas analisis sentimen harus diperhalus dari tingkat "produk" ke tingkat "fitur produk". Misalnya, saat menjelajah ulasan ponsel, analisis sentimen tidak hanya untuk produk secara keseluruhan tetapi juga untuk kata kunci spesifik seperti "umur baterai" dan "kinerja kamera" untuk memandu perbaikan produk.

4. Generasi Pelanggan Otomatis dan Ekspansi Pasar

Untuk perusahaan B2B, menemukan pelanggan potensial dan mitra pasar adalah kunci pertumbuhan berkelanjutan. Web scraping dapat mengotomatisasi proses ini yang melelahkan.

Dengan menjelajah data dari direktori industri, daftar perusahaan, papan lowongan kerja, dan platform sosial profesional, database pelanggan target dapat dibangun, termasuk nama perusahaan, kontak, jabatan, teknologi yang digunakan, dan ukuran perusahaan.

【Saran Praktis】: Menggabungkannya dengan solusi CAPTCHA yang disebutkan dalam tautan internal dapat lebih efektif mengatasi mekanisme anti-scraping dari situs target, memastikan kelanjutan dan akurasi data pelanggan. Contohnya, menggunakan alat seperti CapSolver untuk menyelesaikan tantangan CAPTCHA kompleks AWS WAF atau reCAPTCHA memastikan proses penjelajahan otomatis tetap tidak terganggu.

Bacaan Lanjutan: Menyelesaikan tantangan CAPTCHA kompleks adalah langkah kritis dalam memperoleh pelanggan penjualan berkualitas tinggi. Pelajari lebih lanjut tentang informasi menyelesaikan CAPTCHA AWS WAF dan reCAPTCHA v2/v3.

5. Intelijen Pasar Keuangan dan Prediksi Risiko

Industri keuangan menuntut standar yang sangat tinggi untuk kemampuan real-time dan akurasi data. Web scraping memainkan peran yang tidak tergantikan dalam intelijen keuangan, perdagangan algoritmik, dan manajemen risiko.

- Insight Bisnis: Menjelajah laporan real-time dari agen berita, pengumuman regulasi , dan diskusi keuangan di media sosial untuk membangun strategi perdagangan berbasis peristiwa.

- Machine Learning: Melatih model untuk mengidentifikasi indikator sentimen dan indeks ketidakpastian dalam teks berita untuk memprediksi fluktuasi harga saham jangka pendek.

【Nilai Berbeda】: Di luar data keuangan tradisional, menjelajah data rantai pasok (seperti informasi publik tentang pelacakan pengiriman dan status produksi pabrik) dapat memberikan sinyal makroekonomi dini untuk keputusan investasi—keunggulan unik yang sering kali tidak dimiliki sumber data keuangan tradisional.

III. Perbandingan Pemilihan Teknologi Web Scraping: Efisiensi vs. Mekanisme Anti-Bot

Memilih stack teknologi yang tepat sangat penting saat menerapkan proyek web scraping. Berikut adalah perbandingan beberapa metode penjelajahan utama dalam hal efisiensi, kemampuan anti-bot, dan biaya:

| Fitur | Crawler yang Dibangun Sendiri (misalnya, Python/Scrapy) | Layanan Penjelajahan Komersial (misalnya, Scraping API) | Browser Tanpa Kepala (misalnya, Puppeteer/Playwright) |

|---|---|---|---|

| Biaya Pengembangan | Tinggi (Memerlukan penanganan semua detail) | Rendah (Panggilan API, integrasi cepat) | Menengah (Memerlukan penanganan lingkungan browser dan konsumsi sumber daya) |

| Efisiensi Penjelajahan | Sangat Tinggi (Dioptimalkan untuk target spesifik) | Tinggi (Penyedia mengelola pemeliharaan) | Rendah (Konsumsi sumber daya tinggi, kecepatan lambat) |

| Kemampuan Anti-Bot | Tinggi (Strategi anti-bot yang dapat dikustomisasi) | Sangat Tinggi (Tim profesional mengelola pool proxy dan fingerprinting) | Menengah (Meniru perilaku browser nyata) |

| Kesulitan Pemeliharaan | Sangat Tinggi (Pembaruan sering diperlukan untuk perubahan struktur situs web) | Rendah (Penyedia mengelola pemeliharaan) | Menengah (Pembaruan browser dan konfigurasi lingkungan) |

| Kasus Penggunaan Terbaik | Proyek jangka panjang, skala besar, dan sangat dikustomisasi | Kebutuhan data komersial cepat, stabil, dan konkuren tinggi | Skenario yang membutuhkan eksekusi JavaScript kompleks atau login |

【Wawasan Unik】: Untuk aplikasi komersial yang menuntut efisiensi tinggi dan kemampuan anti-bot kuat, Layanan Penjelajahan Komersial sering kali menjadi pilihan yang lebih hemat biaya, karena mengalihkan pekerjaan kompleks manajemen proxy dan pemeliharaan anti-bot ke tim khusus.

IV. Tantangan dan Solusi dalam Penerapan Web Scraping

Meskipun web scraping memiliki potensi besar, operasional praktisnya masih menghadapi banyak tantangan, terutama dalam skenario pengumpulan data skala besar dan frekuensi tinggi.

Tantangan 1: Peningkatan Mekanisme Anti-Bot

Mekanisme anti-bot situs web semakin kompleks, mulai dari blokir IP sederhana hingga analisis perilaku yang rumit, fingerprinting TLS, dan tantangan CAPTCHA.

Solusi:

- Gunakan Layanan Proxy Berkualitas Tinggi: Gabungkan proxy perumahan atau datacenter untuk mengganti IP dan menghindari pemblokiran.

- Meniru Perilaku Pengguna Nyata: Gunakan browser tanpa kepala untuk meniru gerakan mouse, penggulungan, dan klik, serta ubah parameter seperti User-Agent dan Header untuk meniru pengguna biasa.

- Integrasikan Solusi CAPTCHA Profesional: Untuk tantangan seperti reCAPTCHA, clouflare, atau CAPTCHA AWS WAF, integrasikan layanan solusi CAPTCHA pihak ketiga profesional (seperti CapSolver) untuk mencapai bypass otomatis.

Tantangan 2: Batas Hukum dan Etika

Penjelajahan data harus mematuhi hukum, peraturan, dan ketentuan layanan situs web.

Solusi:

- Hanya Menjelajah Data Publik: Hindari secara ketat menjelajah data pribadi atau data yang memerlukan akses login.

- Patuhi Protokol robots.txt: Periksa file

robots.txtsitus target sebelum menjelajah dan hormati pembatasan yang ditetapkan pemilik situs. - Kontrol Frekuensi Penjelajahan: Tetapkan interval permintaan yang wajar untuk menghindari beban berlebihan pada server situs target.

V. Kesimpulan dan Outlook

Web scraping adalah bagian yang tidak terpisahkan dari strategi bisnis berbasis data perusahaan modern. Dengan menerapkannya ke area inti seperti pembuatan data pelatihan AI, harga dinamis, analisis sentimen pasar, generasi pelanggan otomatis, dan intelijen pasar keuangan, bisnis dapat memperoleh wawasan komersial real-time dan akurat serta mempertahankan keunggulan kompetitif.

Strategi web scraping yang sukses tidak hanya terletak pada kemajuan teknologi tetapi juga pada kepatuhan terhadap regulasi hukum, penghormatan terhadap etika data, dan penyesuaian terus-menerus terhadap tantangan anti-bot. Dengan pengembangan teknologi AI yang terus berlangsung, masa depan web scraping akan lebih cerdas dan adaptif, membawa kedalaman dan cakupan yang tidak terduga dalam pengambilan keputusan bisnis.

Lampiran: Pertanyaan yang Sering Diajukan (FAQ)

T1: Apakah web scraping legal?

J1: Kepatuhan web scraping tergantung pada konten dan metode penjelajahan spesifik. Secara umum, menjelajah data yang dapat diakses publik (tanpa login, tanpa informasi pribadi) legal. Namun, Anda harus mematuhi secara ketat protokol robots.txt dan ketentuan layanan situs target. Menjelajah konten hak cipta atau data pribadi adalah ilegal. Disarankan untuk berkonsultasi dengan profesional hukum dan selalu melakukan pengumpulan data secara bertanggung jawab dan etis.

T2: Dapatkah data yang dijelajah langsung digunakan untuk model Machine Learning?

J2: Secara umum, tidak. Data mentah yang dijelajah sering kali mengandung noise signifikan, nilai yang hilang, format yang tidak konsisten, dan masalah lainnya. Sebelum digunakan untuk model Machine Learning, harus melalui langkah-langkah pembersihan data, transformasi data, dan insinyur fitur yang ketat untuk memastikan kualitas data dan akurasi model.

T3: Apa perbedaan antara web scraping dan panggilan API?

J3: API (Application Programming Interface) adalah antarmuka resmi yang secara aktif disediakan oleh situs web atau layanan untuk memperoleh data yang terstruktur; stabil, efisien, dan legal. Web scraping mengekstrak data dari konten HTML situs web dan digunakan saat API tidak tersedia atau fungsinya terbatas. Selalu utamakan penggunaan API; pertimbangkan web scraping hanya saat API tidak tersedia atau tidak memadai untuk kebutuhan Anda.

T4: Bagaimana CapSolver membantu masalah CAPTCHA dalam web scraping?

J4: CapSolver adalah layanan penyelesaian CAPTCHA otomatis profesional. Layanan ini menggunakan teknologi AI dan Machine Learning lanjutan untuk secara otomatis mengenali dan menyelesaikan berbagai jenis CAPTCHA kompleks, seperti reCAPTCHA v2/v3, Cloudflare, dan CAPTCHA AWS WAF dan lainnya. Dengan mengintegrasikan API CapSolver ke dalam alur kerja penjelajahan Anda, Anda dapat mencapai pengumpulan data otomatis tanpa gangguan, secara efektif menyelesaikan hambatan CAPTCHA dalam mekanisme anti-bot.

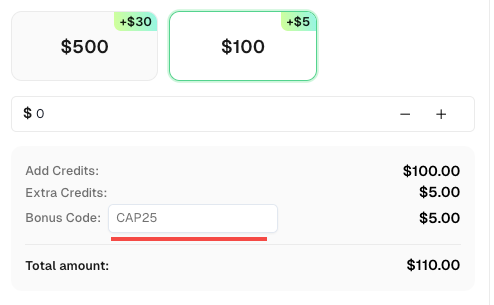

Klaim Kode Bonus CapSolver Anda

Jangan lewatkan kesempatan untuk mengoptimalkan operasi Anda lebih lanjut! Gunakan kode bonus CAP25 saat menambahkan dana ke akun CapSolver Anda dan dapatkan bonus tambahan 5% untuk setiap penambahan dana, tanpa batas. Kunjungi Dashboard CapSolver untuk klaim bonus Anda sekarang!

T6: Bagaimana saya memastikan web scraping saya berkelanjutan (yaitu, tidak akan rusak karena perubahan struktur situs web)?

J6: Perubahan struktur situs web adalah tantangan terbesar dalam penjelajahan. Solusi termasuk:

- Gunakan kombinasi selektor CSS atau XPath: Jangan mengandalkan satu selektor yang terlalu spesifik.

- Bangun sistem pemantauan dan pemberitahuan: Periksa secara teratur status pengambilan data penting dan segera beri peringatan jika pengambilan data gagal.

- Gunakan alat pengambilan data berbasis AI: Beberapa alat canggih (seperti Prompt-Based Scrapers yang disebutkan dalam tautan internal) dapat menggunakan AI untuk menyesuaikan diri dengan perubahan kecil pada struktur situs web, mengurangi biaya pemeliharaan.

Lihat Lebih Banyak

web scrapingApr 22, 2026

Arsitektur Pengambilan Data Web Rust untuk Ekstraksi Data yang Dapat Diskalakan

Pelajari arsitektur pengambilan data web Rust yang dapat diskalakan dengan reqwest, scraper, pengambilan data asinkron, pengambilan data browser tanpa tampilan, rotasi proxy, dan penanganan CAPTCHA yang sesuai aturan.

web scrapingFeb 17, 2026

Cara menyelesaikan Captcha di Nanobot dengan CapSolver

Mengotomasi penyelesaian CAPTCHA dengan Nanobot dan CapSolver. Gunakan Playwright untuk menyelesaikan reCAPTCHA dan Cloudflare secara otomatis.